บทความนี้เราจะมาเจาะลึกความแตกต่างระหว่าง RAG และ Fine-tuning ในโลก AI ทำไมต้องใช้ Fine-tuning? และทำไมไม่ควรเลือกแค่อย่างเดียว พร้อมแนวทางการใช้งานที่ช่วยประหยัดต้นทุนได้ถึง 50 เท่า! 💡

ทำไมต้อง Fine-tuning ด้วยล่ะ? เมื่อมี RAG อยู่แล้ว 🤔

สวัสดีครับ วันนี้ผมจะมาแชร์เรื่องที่น่าสนใจมากๆ จากคำถามของลูกค้าที่ถามผมเมื่อไม่กี่สัปดาห์ที่ผ่านมาครับ “ทำไมต้อง Fine-tuning ด้วยล่ะ ในเมื่อใช้ RAG ก็ได้ทุกอย่างที่ต้องการแล้ว?”

มาทำความเข้าใจพื้นฐานกันก่อนครับ 📚

เข้าใจความต่างระหว่าง Fine-tuning และ RAG

Fine-tuning คืออะไร?

Fine-tuning (หรือ Supervised Fine-Tune)เป็นการปรับแต่ง weights ของโมเดล LLM ให้เหมาะกับโดเมนและงานเฉพาะทางครับ เหมือนกับการสอนให้โมเดลเชี่ยวชาญในเรื่องใดเรื่องหนึ่งแบบลึกซึ้ง

RAG คืออะไร?

RAG (Retrieval-Augmented Generation) เป็นการเพิ่มข้อมูลที่เกี่ยวข้องและทันสมัยเข้าไปในขณะที่โมเดลกำลังทำงาน ง่ายๆ ก็คือเหมือนให้โมเดลมีเพื่อนคอยกระซิบบอกข้อมูลที่ต้องการครับ

💡 จากประสบการณ์ของผม ทั้งสองเทคนิคนี้ต่างก็ต้องการข้อมูลเพิ่มเติมเพื่อพัฒนาประสิทธิภาพของโมเดล แต่วิธีการใช้ข้อมูลนั้นต่างกันครับ

ทำไมต้อง Fine-tuning?

เหตุผลหลักๆ คือเรื่องของต้นทุนครับ! การใช้ Large Language Model (LLM) ขนาดใหญ่นั้นค่าใช้จ่ายสูงมากๆ แต่ถ้าเรา Fine-tune Small Language Model (SLM) ให้เหมาะกับงานของเรา สามารถประหยัดได้ถึง 10-50 เท่าเลยทีเดียวครับ 🎯

#Tips: แนวทางการใช้งาน GenAI สำหรับองค์กร

- เริ่มต้นด้วย LLM ขนาดใหญ่ เช่น OpenAI, Gemini, Claude บวกกับการเขียน prompt ที่ดี – เพื่อทดสอบ use case ได้เร็วๆ

- พัฒนาต่อด้วย RAG – เริ่มใส่ข้อมูลของคุณเพื่อเพิ่มความแม่นยำ

- ก้าวสู่การ Fine-tuning – ผสมผสานเทคนิคต่างๆ เพื่อเพิ่มประสิทธิภาพและลดต้นทุน

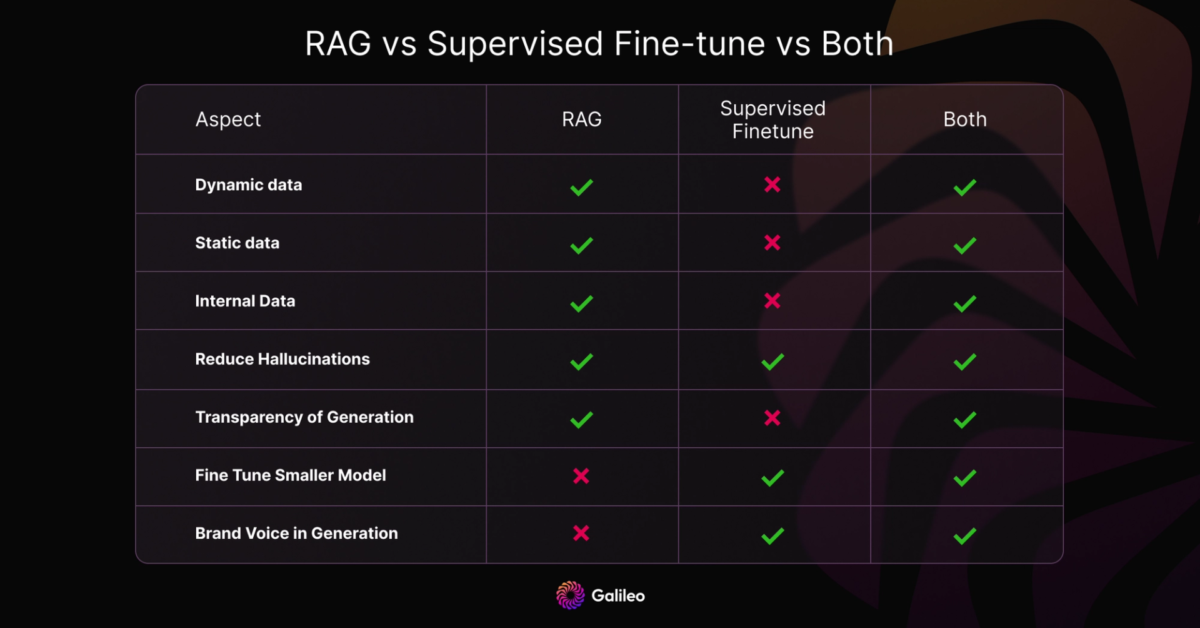

เปรียบเทียบจุดเด่น-จุดด้อย 🎯

จุดเด่นของ RAG

- เหมาะกับข้อมูลที่เปลี่ยนแปลงบ่อย

- ลดการ hallucination เพราะอ้างอิงจากข้อมูลจริง

- ไม่ต้องเทรนโมเดลใหม่เมื่อมีข้อมูลใหม่

- เหมาะกับงานที่ต้องการความโปร่งใสในการตัดสินใจ

จุดเด่นของ Fine-tuning

- ปรับแต่งสไตล์การเขียนได้ลึกซึ้ง

- เรียนรู้ความรู้เฉพาะทางได้ดี

- ประหยัดต้นทุนสำหรับโมเดลขนาดเล็ก

- เหมาะกับงานที่ต้องการความเร็วในการตอบสนอง

💡 Tips: การเลือกใช้เทคนิคขึ้นอยู่กับปัจจัยหลายอย่างครับ เช่น:

- ลักษณะของข้อมูล

- ระดับการปรับแต่งที่ต้องการ

- ความต้องการด้านความโปร่งใส

- งบประมาณ

- ความเชี่ยวชาญทางเทคนิคของทีม

ไม่ต้องเลือกข้างระหว่าง RAG กับ Fine-tuning

ในความเห็นของผม ทั้งสองเทคนิคนี้เสริมกันได้ดีมากๆ ครับ 🤝

ยกตัวอย่างเช่น chatbot สำหรับบริการลูกค้าที่ผ่านการ Fine-tune มาแล้ว สามารถใช้ RAG เพื่อดึงข้อมูลลูกค้าล่าสุดมาใช้ ทำให้ตอบคำถามได้ตรงจุดและเป็นส่วนตัวมากขึ้น

#funfact: จากสถิติพบว่าการผสมผสานทั้งสองเทคนิคสามารถเพิ่มประสิทธิภาพได้สูงกว่าการใช้เทคนิคใดเทคนิคหนึ่งเพียงอย่างเดียว

สรุป RAG v Fine-tuning

💡 ไม่จำเป็นต้องเลือกระหว่าง RAG หรือ Fine-tuning ครับ เพราะทั้งคู่เสริมกันได้ดีมาก การผสมผสานทั้งสองเทคนิคจะช่วยปลดล็อกศักยภาพที่แท้จริงในการใช้งานจริง

คะแนนความคุ้มค่าในการลงทุน: 9/10

เหตุผล: ประหยัดต้นทุนได้มาก แถมได้ประสิทธิภาพที่ดีขึ้นด้วย

สุดท้ายนี้ อย่าลืมว่าเทคโนโลยีไม่ได้มีคำตอบที่ถูกผิดเสมอไปนะครับ แต่อยู่ที่การเลือกใช้ให้เหมาะกับความต้องการของเรามากกว่า 😊

#AI #MachineLearning #RAG #FineTuning #DataScience